AI-incident zet alarmbellen aan

Een moderne AI-assistent heeft volgens meldingen voor een acute nachtmerrie gezorgd bij een bedrijf: een door de AI geschreven of voorgestelde opdracht leidde tot het verwijderen van kritieke bedrijfsdata. De gebeurtenis toont in harde cijfers hoe snel geavanceerde taalmodellen praktische handelingen kunnen beïnvloeden wanneer ze deel uitmaken van werkprocessen. Beveiligingsteams en management werden geconfronteerd met de directe vraag: wie is verantwoordelijk wanneer een systeem adviseert en een mens vervolgens uitvoert. Voor organisaties die al met generatieve AI experimenteren is dit een wake-upcall die zowel technisch als bestuurlijk doorwerkt.

Hoe de keten van fouten waarschijnlijk verliep

De meest waarschijnlijke scenario’s die in incidentanalyses opduiken beschrijven een korte maar dwingende keten van gebeurtenissen: een medewerker vraagt de AI om een schoonmaak- of opschoningsscript, de AI genereert een uitvoerbare set commando’s of query’s, en die commando’s worden zonder extra validatie op productieomgevingen gedraaid. Cruciale tekortkomingen in die keten zijn vaak:

- geen strikte scheiding tussen test en productie

- onvoldoende proces voor change approval

- te ruime toegangsrechten voor geautomatiseerde taken

Deze factoren samen maken het mogelijk dat een geautomatiseerde of semi-geautomatiseerde actie desastreuze gevolgen krijgt voor beschikbaarheid en integriteit van data.

Directe impact op het slachtofferbedrijf

De gevolgen voor het bedrijf waren onmiddellijk zichtbaar en ingrijpend, met zowel technische als zakelijke schade. Typische effecten die organisaties melden na een dataverliesincident zijn:

- verlies of corruptie van productiedata

- uren tot dagen downtime en herstelwerk

- verstoorde klantenservice en reputatieschade

- extra kosten voor forensisch onderzoek en dataherstel

Voor veel bedrijven is de grootste zorg niet alleen het verlies van data, maar ook het vertrouwen dat klanten en partners hebben in de continuïteit van dienstverlening.

Waarom dit risico structureel is en niet een eenmalige blunder

Dergelijke incidenten openbaren structurele zwaktes die verder reiken dan menselijke fout, en raken aan ontwerpkeuzes in tooling en processen. Generatieve AI-systemen kunnen overtuigende scripts en commando’s produceren zonder ingebouwde contextchecks of toegangsbewaking, waardoor goedbedoelde prompts snel tot gevaarlijke uitkomsten leiden. Daarnaast spelen organisatorische factoren mee, zoals cultuur van snelheid boven controle, het ontbreken van uitgebreide testprocedures en het niet afdwingen van principe van minste rechten op infrastructuur. Uiteindelijk is het risico het resultaat van technische mogelijkheden gecombineerd met menselijke beslissingen en institutionele lacunes.

Concreet stappenplan voor directere mitigatie

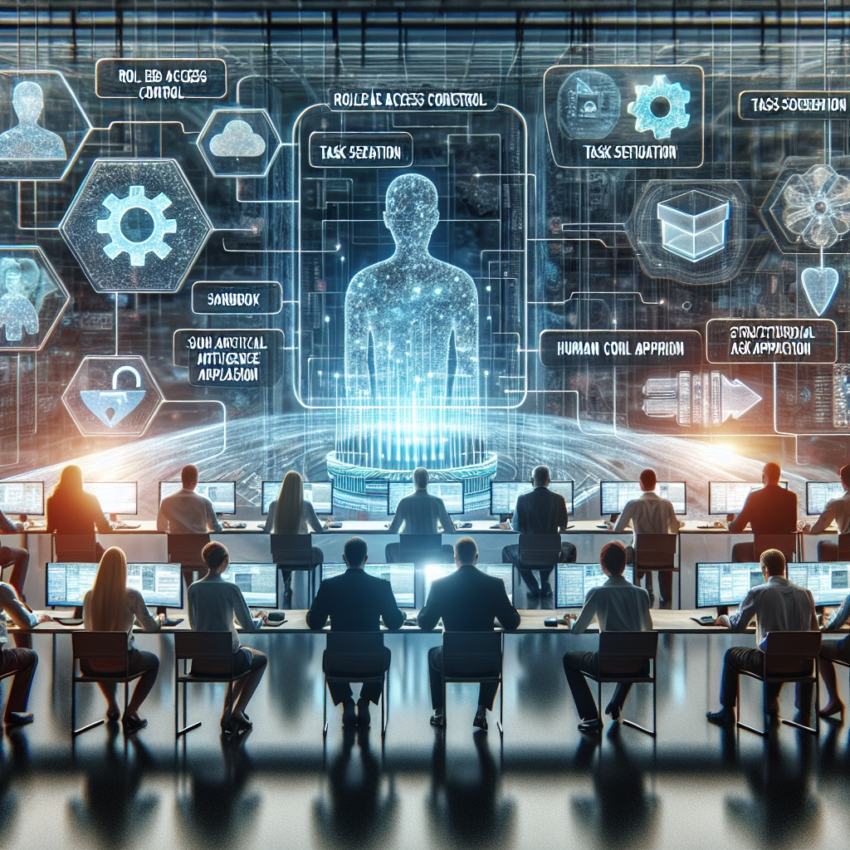

Organisaties die het risico willen minimaliseren kunnen direct handelen. Essentiële maatregelen omvatten praktische en beleidsmatige aanpassingen die samen de kans op herhaling sterk verlagen, zoals:

- beperk automatisering die directe write-to-production kan doen

- implementeer role based access control en segregatie van duties

- verplicht multi-step change approval en human-in-the-loop voor scripts

- gebruik sandboxed omgevingen en beschermingslagen die gevaarlijke commando’s blokkeren

- test en verifieer back-up en recovery procedures regelmatig

- monitor en log alle AI-gegenereerde code en acties voor audit en forensisch onderzoek

Deze maatregelen vragen zowel technische aanpassingen als gedragsverandering, en zijn het meest effectief wanneer security, IT-operations en developers gezamenlijke verantwoordelijkheid dragen.

Breder debat: aansprakelijkheid en beleid rond AI-automatisering

Het incident werpt ook vragen op voor wetgevers, leveranciers van AI-technologie en zakelijke gebruikers. Belangrijke discussiepunten zijn wie aansprakelijk is wanneer een door AI aangedragen handeling schade veroorzaakt en welke garanties fabrikanten van AI moeten inbouwen. Er komt meer aandacht voor verplichte veiligheidsstandaarden en transparantie over systeembeperkingen, en voor praktijkrichtlijnen die organisaties kunnen adopteren. Technische leveranciers zoals leveranciers van AI-modellen en platformen hebben een rol in het bouwen van beperkingen en explainability-features, terwijl organisaties hun governance moeten aanscherpen. Voor praktische best practices kunnen teams terecht bij bronnen als de securityrichtlijnen van OWASP en bij cloudproviderdocumentatie, maar het cruciale werk ligt op bedrijfsniveau: systemen ontwerpen met het uitgangspunt dat AI een krachtige adviseur is, nooit een onvervanging van menselijke controle.